苹果悬赏100万美元:寻找AI模型云漏洞高手

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

苹果在官网博客推出了一项悬赏活动,为即将推出的Apple Intelligence和AI云模型服务做安全准备。这也是目前最高的AI模型悬赏之一,鼓励研究人员帮助苹果找出那些潜在的模型安全漏洞。

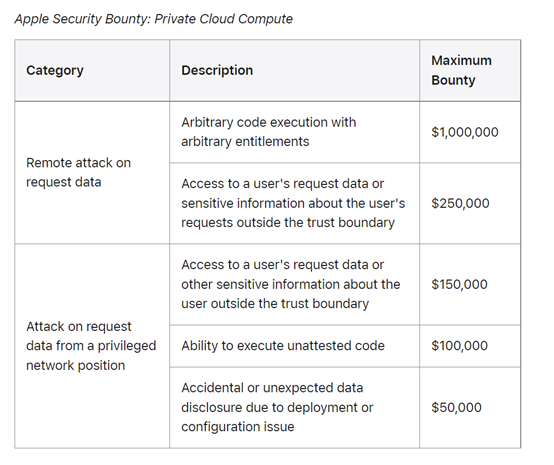

本次悬赏分为两大类别,5个奖金档次,最高100万美元,最低5万美元。悬赏计划主要关注意外数据暴露、通过用户请求的外部攻击,以及需要物理或内部访问的漏洞三大方向。

对请求数据的远程攻击:1)找出具有任意权限的恶意代码执行,奖励100万美元;2)在信任边界之外访问用户的请求数据,或有关用户请求的敏感信息,奖励25万美元;

从特权网络位置攻击请求数据:1)找出在信任边界之外访问用户的请求数据,或有关用户的其他敏感信息,奖励15万美元;2)找出执行未经验证的代码,奖励10万美元;

3)由于部署或配置问题导致意外或意外的数据泄露,奖励5万美元。

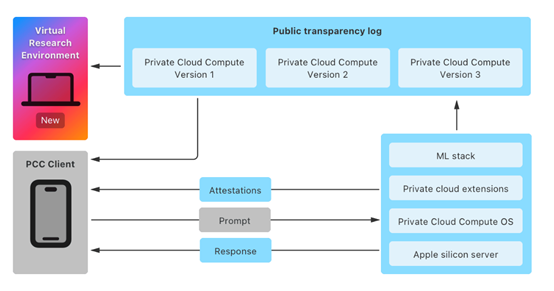

为了帮助安全研究人员检测系统,苹果公司发布了关键安全组件的源代码,并提供了一个至少需要16GB内存的Apple Silicon Mac上运行的虚拟研究环境。这个环境可让研究人员在保持用户隐私的同时,检查系统如何处理AI请求。

有兴趣的小伙伴可以通过访问最新的macOS Sequoia 15.1开发者预览版中的Private Cloud Compute虚拟研究环境来开始寻找这些漏洞。

了解详细悬赏和执行情况:https://security.apple.com/bounty

本文素材来源苹果官网,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区