世界最好小参数开源大模型!超谷歌、Meta,手机、平板轻松运行

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

法国著名大模型平台Mistral.AI开源了最新小参数模型——Ministraux。

Ministraux一共有Ministral 3B和8B两个版本,是专为手机、平板、笔记本等移动设备设计,在文本生成、推理、函数调用和效率方面非常强悍,大幅度超过了Meta的Llama-3.2和谷歌的Gemma-2,重新定义100亿参数以下小模型的性能。

所以,Mistral.AI在发布时也挺直接,这是目前世界最好的开源小参数模型。

开源地址:https://huggingface.co/mistralai/Ministral-8B-Instruct-2410

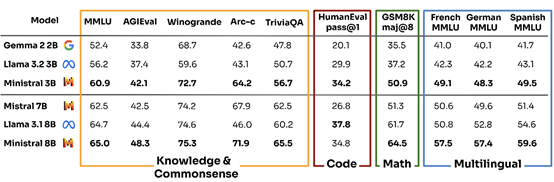

从Mistral.AI公布的测试数据来看,Ministraux的性能确实不错。以最小参数的3B为例,在MMLU、AGIEval、Winogrande、Arc-c、TriviaQA等主流基准测试平台中,分别达到了60.9、42.1、72.7、64.2、56.7的超高分数。

比谷歌的Gemma-2-2B、Meta的Llama-3.2-3B性能高出一大截,甚至超过了70亿参数的模型性能。

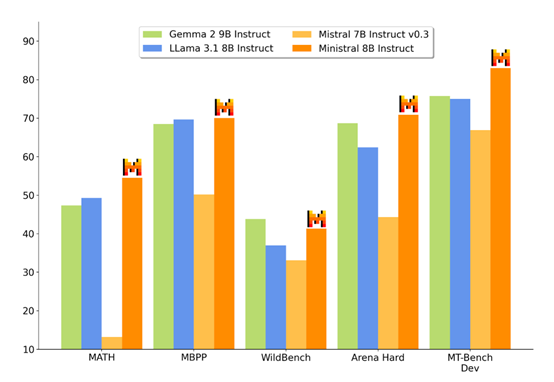

而8B版本与Meta、谷歌开源的同类模型相比,在主流测试基准中同样大幅度超越。

Ministral 3B和8B支持128k上下文长度,能够处理超长文本序列,这对于打造AI翻译、离线AI助手、本地数据分析AI助手等非常有帮助。

此外,如果你想开发一个更复杂的AI助手,也可以将Ministraux与Mistral Large等参数较大的模型混合使用,可以充当多流程的智能代理,处理输入解析、任务路由,并根据用户意图在极低延迟和成本下调用多个上下文的API。

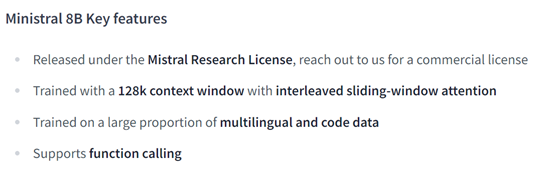

架构方面,Ministral 8B版本使用了特殊的交错滑动窗口注意力机制,极大提升了推理效率、内存利用率以及用户响应,这也是能在移动端使用离线大模型的主要原因之一。

传统的Transformer自注意力机制需要对序列中的每个位置计算与其他所有位置的相似度,这会导致计算量和内存需求呈现二次方增长。

而滑动窗口注意力机制通过限制注意力计算的范围,仅在固定大小的窗口内进行计算,只计算窗口内的位置之间的相似度,并将注意分数归一化得到权重。这可以大幅度减少AI算力,并保持局部依赖性。

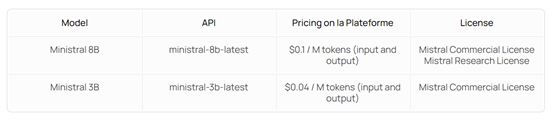

价格方面,如果不是本地部署也可以使用Mistral.AI服务,Ministral 8B 的API定价为每百万输入和输出token0.1美元,而Ministral 3B 的定价为每百万输入和输出token 0.04美元。

Mistral.AI表示,新发布的Ministraux只是他们对小参数模型的尝试,效果却非常好超过了一年前发布的Ministral 7B。

未来会继续开源更多高性能、小参数的模型,让更多的开发者可以轻松在本地部署使用。

本文素材来源Mistral.AI,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区