阿里开源新语音模型,比OpenAI的Whisper更好!

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

阿里巴巴在Qwen-Audio基础之上,开源了最新语音模型Qwen2-Audio。

Qwen2-Audio一共有基础和指令微调两个版本,支持使用语音向音频模型进行提问并识别内容以及语音分析。

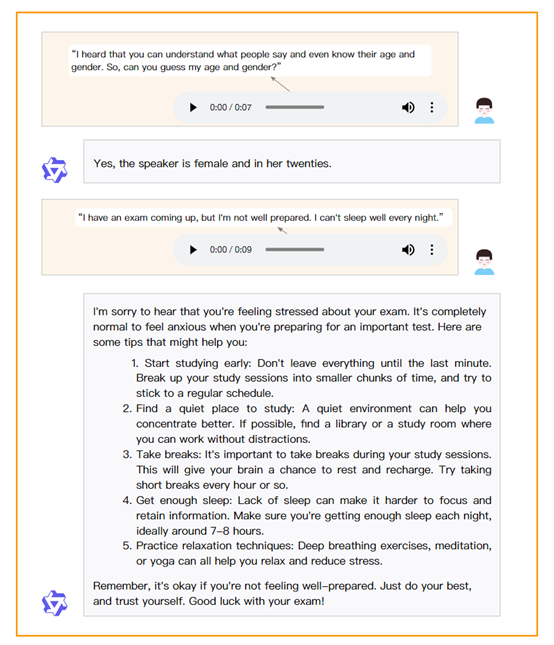

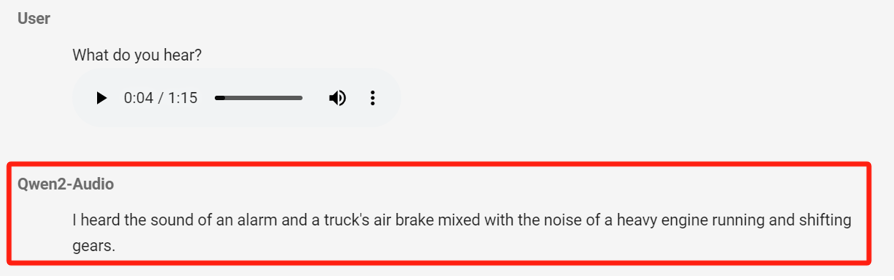

例如,让一位女生说一段话,然后识别她的年纪或解读她的心情;发布一段吵闹的声音,分析有哪些声音组成等。

目前,Qwen2-Audio支持中文、粤语、法语、英语、日语等主流语言和方言,这对于开发翻译、情感分析等应用非常方便。

开源地址:https://github.com/QwenLM/Qwen2-Audio

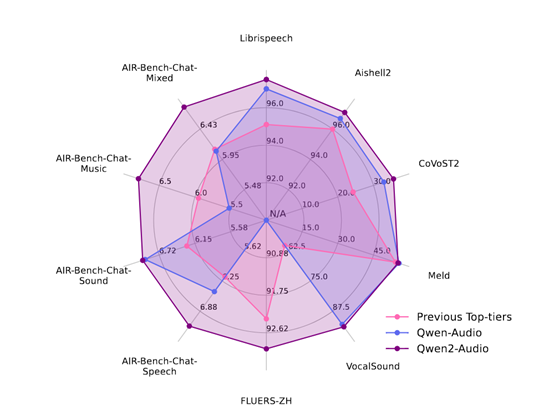

Qwen2-Audio能力大幅度提升

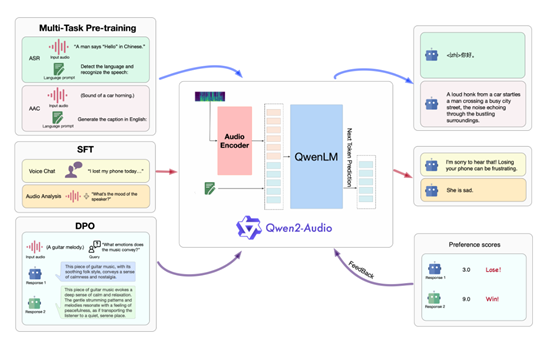

与第一代Qwen-Audio相比,Qwen2-Audio在架构、性能等方面进行了大幅度优化和改进。在预训练阶段Qwen2-Audio采用了自然语言提示,替代了Qwen-Audio使用的复杂分层标签系统。

这一改变简化了模型的训练过程,使得模型能够更自然地理解和响应各种数据和任务,提高了模型的泛化能力能更好地理解和执行各种指令。

Qwen2 – Audio在指令跟随能力方面有了显著提升,通过增加指令调优和直接偏好优化等方法,可更准确地理解用户的指令,并根据指令提供更恰当的响应。

例如,当用户发出语音指令,“分析这段音频中的情感倾向时”,Qwen2 – Audio能够更精准地判断出音频中的情感。

在功能方面Qwen2 – Audio也进行了扩展,支持语音聊天和音频分析两种模式:在语音聊天模式中,用户可以更加自由地与Qwen2 – Audio进行语音交互,就像与朋友聊天一样自然。

在音频分析模式中,Qwen2 – Audio能够对各种类型的音频进行深入分析,提供更详细和准确的分析结果。

此外,Qwen2-Audio还引入了监督式微调(SFT)和直接偏好优化(DPO)两种优化方法。在SFT阶段,模型通过高质量的微调数据进一步与人类意图对齐,这使得Qwen2-Audio在与人类交互时更加自然和准确;

DPO则通过人类标注的好响应和坏响应数据来优化模型,使其输出更符合人类的期望和偏好。

Qwen2-Audio架构简单介绍

Qwen2-Audio使用了OpenAI开源的语音模型Whisper-large-v3作为音频编码器。为了更好地处理音频数据,Qwen2-Audio采用了16kHz的采样频率,并将原始波形转化为128通道的mel谱图,通过25ms窗口大小和10ms跳帧,确保了音频特征的时间分辨率与频谱信息的完整性。

为了减少音频表示的长度,Qwen2-Audio引入一个池化层其步幅为2,编码器输出的每帧大约对应于原始音频信号中40ms的片段。这种处理方式使得模型能够有效地捕捉音频信号的特征,为后续的分析和理解提供了有力的支。

Qwen2-Audio准确输出分析结果

Qwen2-Audio准确输出分析结果

本文素材来源Qwen2-Audio,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区