吴恩达抵制美国SB 1047法案,对开源大模型是毁灭性打击

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

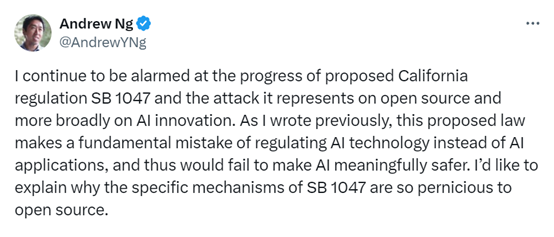

7月12日凌晨,全球著名AI科学家吴恩达(Andrew Ng)在社交平台发表深度长文,再次抵制并吐槽美国加州拟定的SB-1047法案。

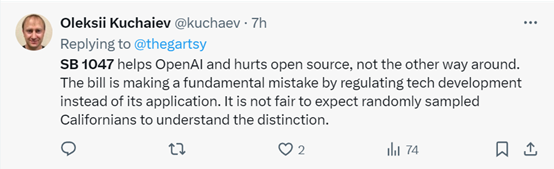

他表示,仍然对美国加州拟定的SB 1047法案,对开源大模型带来的巨大伤害感到震惊。这个法案犯了一个严重根本性错误,应该监管的是通过大模型开发的生成式AI产品,而不是开源大模型本身。

例如,训练成本超过1亿美元的开源大模型,需要每年提供复杂的安全报告,并且如果有人通过他们开源的大模型进行违法行为,包括开发色情、赌博等非法应用,原开发商也会受到法律制裁。

这就相当于,有人去超市买了一把菜刀,然后拿着去砍人,这家超市需要负法律责任,并且每年需要详细报告他卖的菜刀用途以及哪些人使用它在干什么,这种监管规定简直太离谱了!

有趣的是,SB 1047法案主要目的之一是专门用来对付中国的,防止我们使用Meta、谷歌等发布的最新开源模型与美国在生成式AI领域进行竞争。

但国内阿里开源的Qwen-2、Qwen 1.5系列,零一万物开源的Yi系列,已经成为全球最受欢迎的开源大模型之一,Qwen-2的性能还超过了Meta开源的Llama-3排名第一。

所以,不少网友支持吴恩达的观点,SB 1047法案不会阻挡中国在该领域的竞争力,相反,会严重阻挡美国的开源大模型创新。

你给美国科技公司加这么多无理取闹的条条框框法规,只会阻挡他们对科技的创新,让其他国家的科技进步更快。

SB 1047法案明显是针对Meta这样的大公司来的,需要他们在发布开源大模型时,将安全隐患扼杀在萌芽中。硅谷其他领先的闭源模型公司可能不存在这些问题。

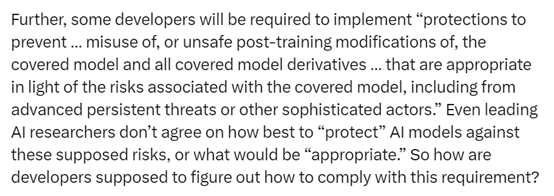

吴恩达还认为,SB 1047法案要求开发人员保护开源大模型的乱用、修改以及开发非法的衍生成式AI产品。但开发人员应该如何保护、如何界定这些行为还非常模糊,没有一个详细的条例。

如果SB 1047法案真正获得通过,那么人们会对制定法律以及审阅这些法规的人感到恐惧。因为,只要定了你的罪名,那么无论你怎么辩解都没用了,就等着审判之锤来敲你的脑袋吧~

所以,吴恩达强烈呼吁大家来抵制SB 1047法案,真的要是通过了将会对开源大模型的创新带来毁灭性打击,同时加州也会失去AI创新的动力。

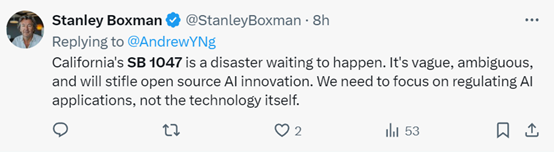

StartupTrek创始人Stanley则支持了吴恩达的说法,这种模糊、界定不清的监管法案,对开源大模型会造成巨大伤害。需要监管的应该是生成式AI应用,而不是大模型本身。

不只是吴恩达,加州大学伯克利分校的教授Ion Stoica在7月11日的听证会上,就表达了对SB 1047法案的看法。

他表示,伯克利开源过很多非常成功的AI项目,也赞同SB 1047在安全方面的考虑。但是,这种一刀切、连带责任的监管方法非常不合理。这不仅不会为开源大模型带来安全生态,相反,会彻底扼杀加州的AI创新。

OpenAI可能是SB 1047法案的最大受益者之一。一旦开源大模型的创新被彻底扼杀,那么闭源大模型将成为一家独大,这显然不是什么好事情。

图灵奖获得者、Meta首席科学家Yann LeCun(杨立昆)之前曾在社交平台也表达了对SB 1047法案的强烈不满。SB1047法案会让开源大模型的原作者承担相当大的风险。没有开源,就没有创新研究,整个生态系统的进步将会非常缓慢。

同时认为该法案的起草者Nirit Weiss-Blatt, PhD,就是这位伪装成学术智库主任的末日邪教大师。

关于SB 1047法案

SB 1047全称是《SB-1047前沿AI大模型安全创新法案》,是美国加州议会在今年2月7日拟定的。经过几个月8次修订、审议,该法案已经通过了一些关键条款,距离正式投票发布已经很近。

这是一个专门针对开源大模型的法案,里面有很多不合理的条款,受到了科技界专业人士的强烈抵抗和不满。

本文素材来源吴恩达社交平台,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区