OpenAI推迟GPT-4o语音模式,还需要一个月时间

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

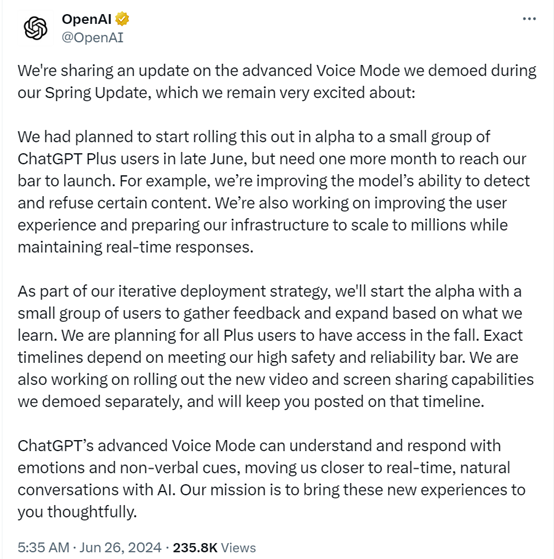

6月26日凌晨,OpenAI在社交平台宣布,推迟GPT-4o语音模式,还需要一个月的时间来完善产品。预计今年秋天,所有ChatGPT Plus用户都可以使用该功能。

OpenAI原本的计划是在6月底开始向一小部分ChatGPT Plus用户提供测试版本,但因为产品还有安全、性能、算力等方面的问题需要调整,所以推迟了发布时间。

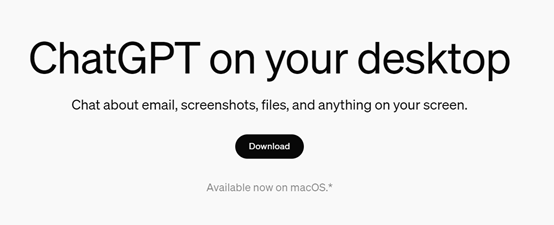

OpenAI还在今天发布了面向macOS系统的桌面版ChatGPT,支持上传文件、搜索对话、图像解读等多种功能。

GPT-4o是OpenAI在今年5月14日发布的最新模型,具备跨文本、语音、视频的推理能力同时可以生成图片,整体性能相当全面。

其语音模式是一大亮点,能够进行自然、流畅的拟人对话,拥有极高的语音识别、理解和生成能力。例如,在医疗领域,GPT-4o语音模式能够帮助医生收集患者病史,提供初步诊断建议,并为患者解答常见的健康问题;

在教育领域,该语音模式能根据学生提供的图片,详细讲解每一步的解答原理以及过程,其能力可以媲美家教老师。

GPT-4o多模态功能展示

所以,全球用户对GPT-4o的语音模式非常期待,渴望拿到属于自己的“贾维斯”。而苹果也已经与OpenAI达成技术合作,希望通过GPT-4o的多模态能力来增强Siri的理解和执行能力。

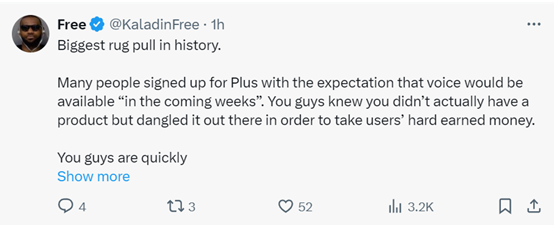

当时OpenAI在展示GPT-4o时,说的是未来几周内提供使用,所以,就有网友嘲讽道几周变4—6个月,典型的OpenAI套路。

值得一提的是,OpenAI在今年2月15日展示的文生视频模型Sora,至今已经四个多月了还处于邀请测试期,距离公测遥遥无期。

至今还有网友惦记着Sora呢~~

如果OpenAI根本没准备好全面公测,你大可不必那么早展示,纯纯吊人胃口啊。

一大堆新注册的ChatGPT Plus用户,不就是为了等GPT-4o语音模式吗,一个月20美元可是辛苦搬砖钱啊~

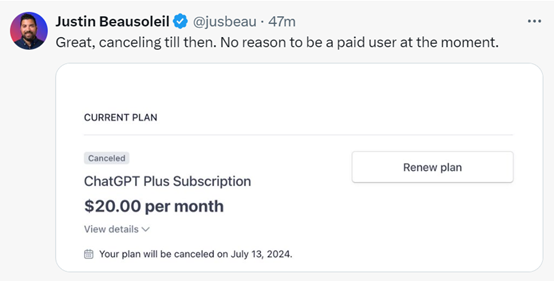

这不,就有用户直接取消了ChatGPT Plus订阅,啥时候上GPT-4o语音模式,再开通了。

OpenAI最近的饼是画的有点多了,全面实现公测的却不多。

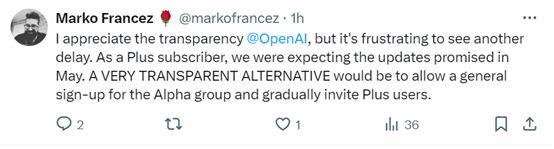

OpenAI确实食言了,当时承诺的是会在短期内逐步向Plus用户开放,现在却又延期有点让人难以接受了。

有的网友还顺路表扬了一下Anthropic最近发布的Claude 3.5 Sonnet,所见即所得,发布就能用。

并且表示,可能Anthropic的多模态语音模型将比GPT-4o更早发布。

不过也有人指出,OpenAI之所以推迟发布,可能和中增根的加入有关,需要在各个方面都符合国家安全局的规定,很快会进入一个枷锁模式。

此外,OpenAI发布了面向macOS桌面版ChatGPT,可以进行文件解读、图片解读、搜索对话等多种功能。

例如,用户可以上传一份PDF文件,基于这些内容向ChatGPT进行提问。

也可以上传一份图片,让ChatGPT解读图像中的内容,或者基于该图片进行文本创作。

当你与ChatGPT聊了几千条内容时,可以通过“搜索对话”功能快速来查找自己想要的内容。

用户在macOS系统打开ChatGPT也很方便,只需要按下Option + Space快捷键即可。

本文素材来源OpenAI官网,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区