谷歌推出多模态视频模型,自动生成丰富动作视频

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

谷歌的研究人员推出了一款多模态扩散模型——VLOGGER。

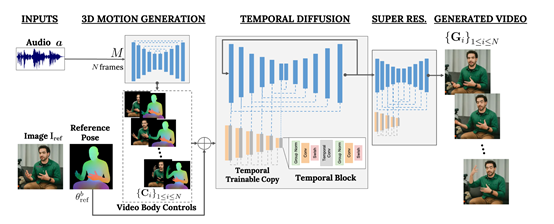

用户只需要向VLOGGER输入图像、语音,就能生成带语音、丰富动作的人物视频。VLOGGER基于扩散模型开发而成,并提出了一种全新的架构,将文本生成图像模型与空间、时间控制相结合,提升视频生成的逼真效果和丰富动作。

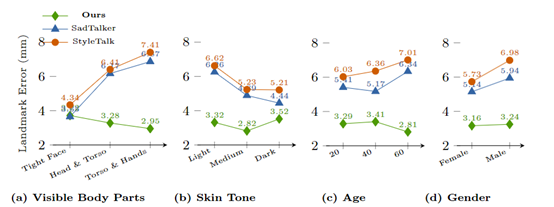

研究人员在HDTF、TalkingHead-1KH和MENTOR等多个数据集对VLOGGER进行了综合测试。结果显示,VLOGGER在视频质量、物体还原性和时序一致性等方面表现出色,同时还能生成丰富的上半身和手势动作。

技术报告:https://enriccorona.github.io/vlogger/paper.pdf

输入的图片

生成的视频

随着数字化经济的飞速发展,各行业对虚拟数字人的需求越来越多。但要制作出逼真的人物动画视频需要大量的人工调整和修补才能获得真实感,不然会出现动作缺失、肢体动作僵硬、五官不协调等问题。

VLOGGER模型的创新之处在于,提出了全新的多阶段扩散模型架构:首先,通过使用随机扩散模型,根据输入语音生成对应的人体运动轨迹,包括表情、姿势、视线和眨眼细节。

然后,使用创新的时空扩散架构,将生成的人体运动轨迹及参考图像作为条件实现完整的人物视频合成。

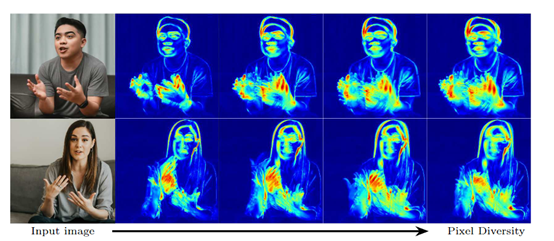

此外,VLOGGER无需针对每个新人物重新训练模型,不依赖人脸检测框选区域,而是直接生成完整目标图像。更重要的是,VLOGGER考虑到了现实中复杂的交流场景,例如,可见躯干、不同身份等,这对正确合成有效交流的人物动作至关重要。

语音生成

第一阶段,VLOGGER使用了Transformer的神经网络用于接收音频波形输入,并生成一系列3D面部表情和身体姿势参数,用于控制虚拟人物在视频中的动作。

为了获得逼真的运动效果,该模型利用了一种统计的3D人体模型,能够精确捕捉面部表情、头部运动、眼球转动、眨眼以及手势等细节。通过预测基于参考图像的姿势残差,该模型可以针对特定身份生成个性化的运动序列。

为了与基于CNN的架构相兼容,该模型将预测的3D参数渲染为密集的2D表示,包括身体的语义区域掩码和部分参考图像的扭曲视图。这些2D控制信号将在下一阶段用于指导视频生成过程。

人物生成

第二阶段,VLOGGER在空间和时间上进行条件控制,以生成高质量、任意长度的视频。该模块接收了来自第一阶段的2D控制信号作为输入,并以参考图像中的人物身份为条件,生成逼真的运动视频帧序列。

VLOGGER基于成熟的文本到图像扩散模型,并通过一种新颖的架构对其进行扩展,增加了时域卷积层,使其能够处理时序数据。此外,VLOGGER还引入了一种”时序外推”的技术,允许模型迭代生成任意长度的视频片段,同时保持时序一致性。

为了提高生成效果,VLOGGER采用了级联扩散方法,对基础分辨率的视频进行超分辨重建,生成高达512×512分辨率的高质量影像。

VLOGGER数据集

为提高VLOGGER的泛化能力和安全性,研究人员构建了一个大规模训练数据集MENTOR。该数据集包含80万名不同身份的人物视频,视频长度总计超过2200小时,覆盖了不同年龄、肤色、体型和文化背景的人群。

值得一提的是,数据集中的视频均捕捉了单个人物在相机前交流的场景,并提供了相应的3D姿势和表情标注,这对于训练VLOGGER的多模态能力发挥了重要作用。

本文素材来源VLOGGER论文,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区