清华文生3D图形新方法,用扩散模型监督NeRF

添加书签

专注AIGC领域的专业社区,关注微软&OpenAI、百度文心一言、讯飞星火等大语言模型(LLM)的发展和应用落地,聚焦LLM的市场研究和AIGC开发者生态,欢迎关注!

清华王霞 投稿

量子位 | 公众号 QbitAI

用文字合成3D图形的AI模型,又有了新的SOTA!

近日,清华大学刘永进教授课题组提出了一种基于扩散模型的文生3D新方式。

无论是不同视角间的一致性,还是与提示词的匹配度,都比此前大幅提升。

文生3D是3D AIGC的热点研究内容,得到了学术界和工业界的广泛关注。

刘永进教授课题组此次提出的新模型叫做TICD(Text-Image Conditioned Diffusion),在T3Bench数据集上达到了SOTA水平。

目前相关论文已经发布,代码也即将开源。

测评成绩已达SOTA

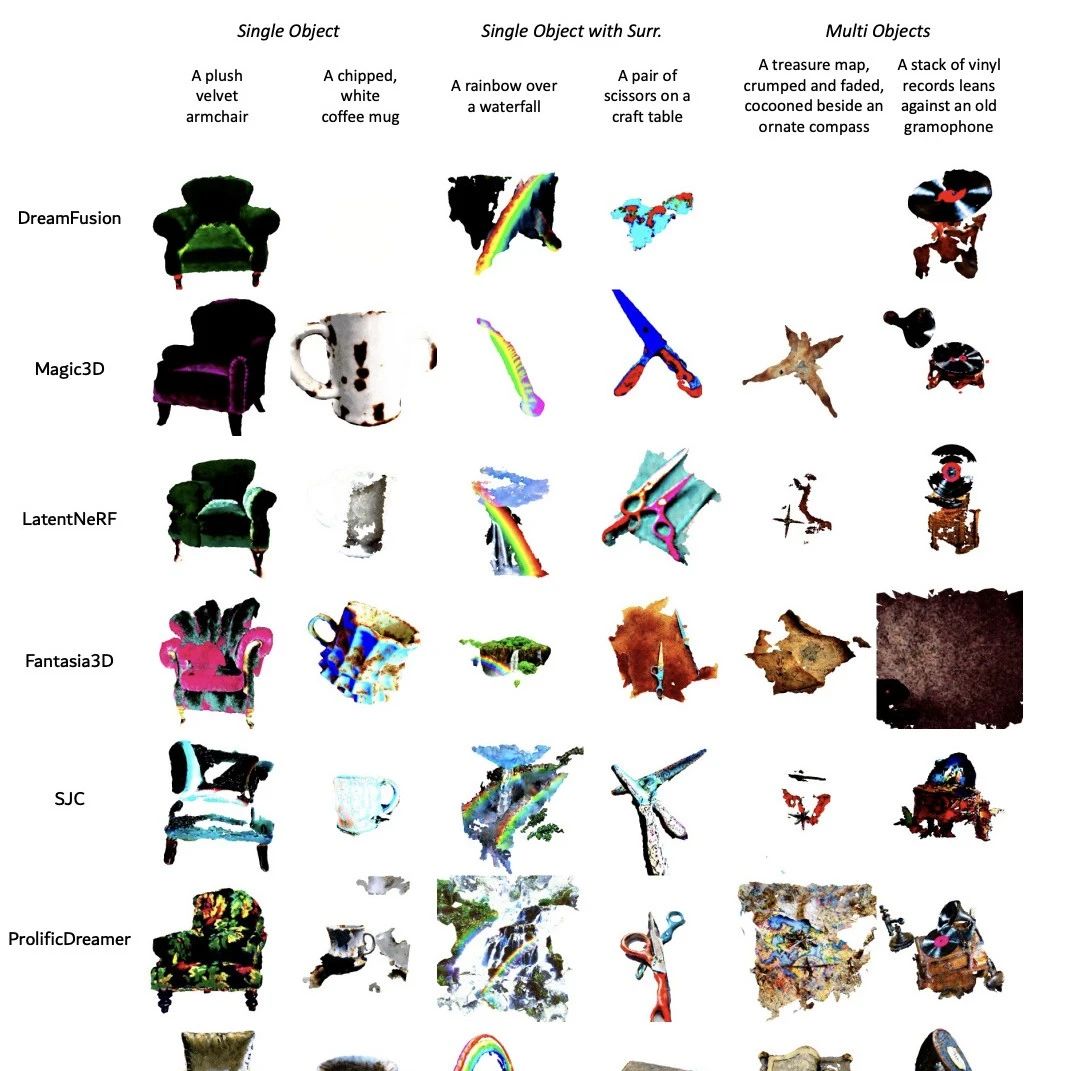

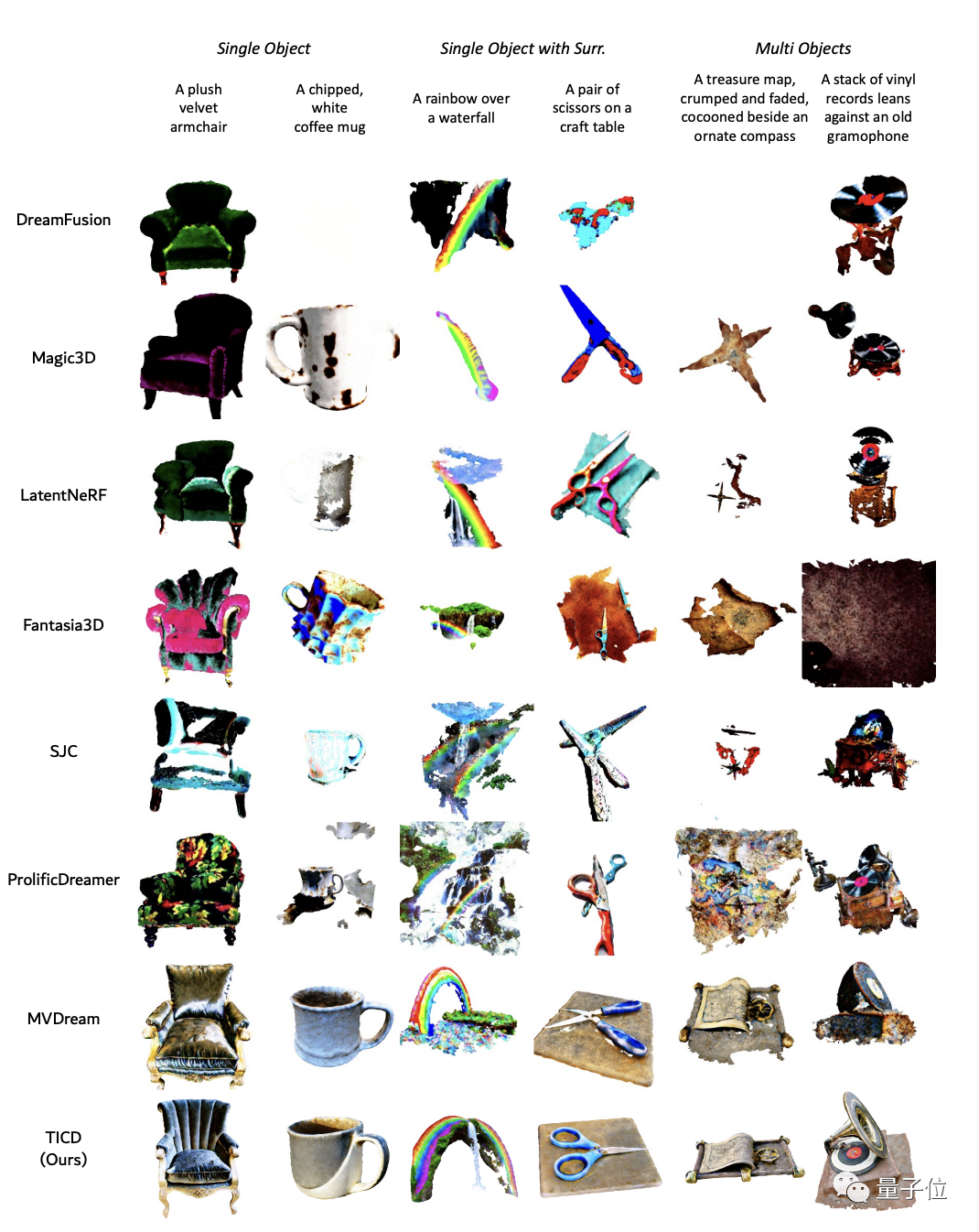

为了评估TICD方法的效果,研究团队首先进行了定性实验,并对比了此前一些较好的方法。

结果显示,用TICD方法生成的3D图形质量更好、图形更清晰,与提示词的匹配程度也更高。

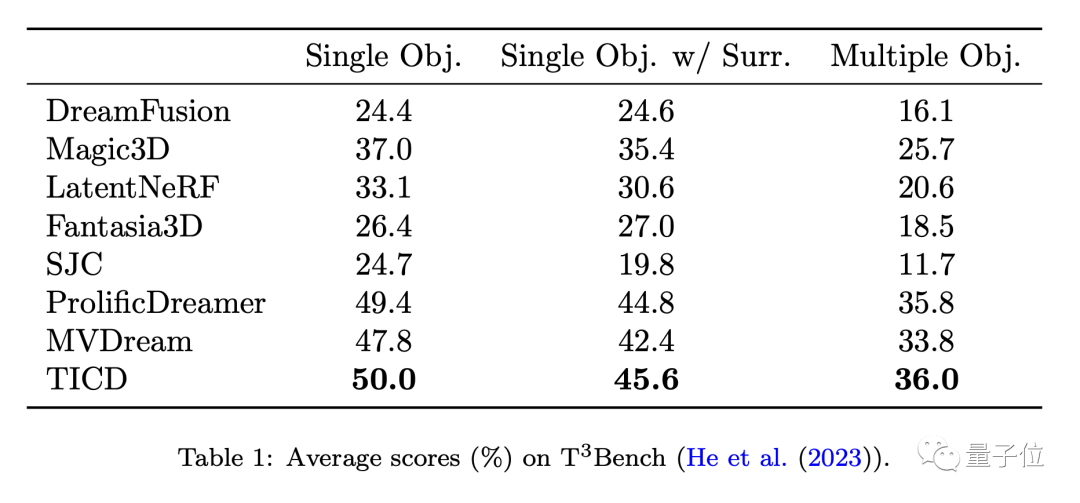

为了进一步评估这些模型的表现,团队在T3Bench数据集上将TICD与这些方法进行了定量测试。

结果显示,TICD在单对象、单对象带背景、多对象这三个提示集上都取得了最好的成绩,证明了它在生成质量和文本对齐性上都具有整体优势。

此外,为了进一步评估这些模型的文本对齐性,研究团队还对3D物体渲染得到的图片与原始提示词的CLIP余弦相似度上进行了测试,结果依然是TICD的表现最佳。

那么,TICD方法是如何实现这样的效果的呢?

将多视角一致性先验纳入NeRF监督

目前主流的文本生成3D方法大多使用预训练的2D扩散模型,通过得分蒸馏采样(Score Distillation Sampling, SDS)优化神经辐射场(NeRF)来生成全新的3D模型。

然而,这种预训练扩散模型提供的监督仅限于输入的文本本身,并未约束多视角间的一致性,可能会出现生成几何结构较差等问题。

为了在扩散模型的先验中引入多视角一致性,一些最新的研究通过使用多视角数据对2D扩散模型进行微调,但仍然缺乏细粒度的视角间连续性。

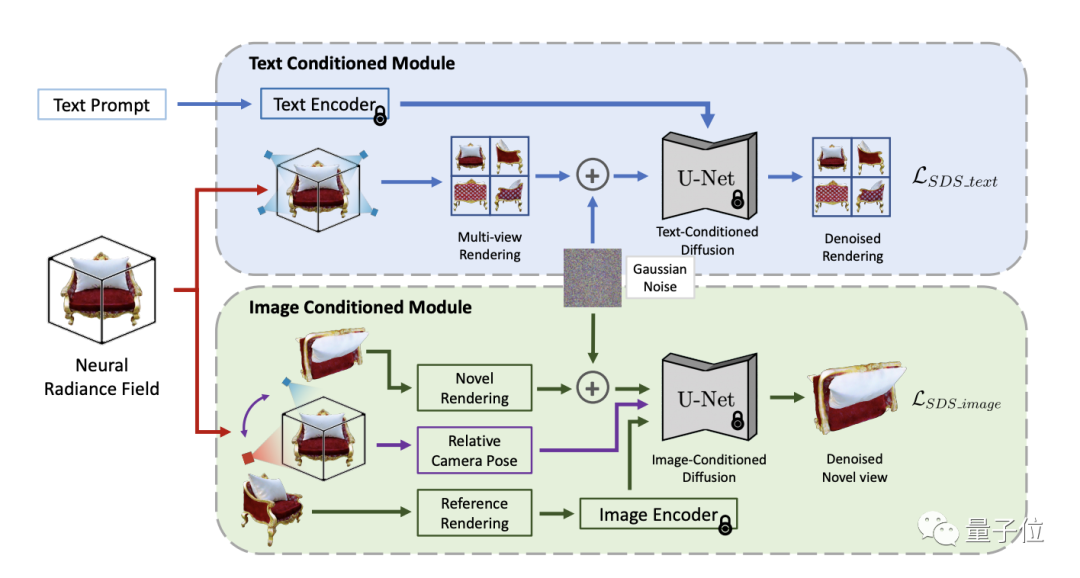

为了解决这一挑战,TICD方法将以文本为条件的和图像为条件的多视角图像纳入NeRF优化的监督信号中,分别保证了3D信息与提示词的对齐和3D物体不同视角间的强一致性,有效提升了生成3D模型的质量。

工作流程上,TICD首先采样若干组正交的参考相机视角,使用NeRF渲染出对应的参考视图,然后对这些参考视图运用基于文本的条件扩散模型,约束内容与文本的整体一致性。

在此基础上选取若干组参考相机视角,并对于每个视角渲染一个额外新视角下的视图。接着以这两个视图与视角间的位姿关系作为新条件,使用基于图像的条件扩散模型约束不同视角间的细节一致性。

结合两种扩散模型的监督信号,TICD可对NeRF网络的参数进行更新并循环迭代优化,直到获得最终的NeRF模型,并渲染出高质量、几何清晰且与文本一致的3D内容。

此外,TICD方法可以有效消除现有方法面对特定文本输入时可能产生的几何信息消失、错误几何信息过量生成、颜色混淆等问题。

论文地址:

https://arxiv.org/abs/2312.11774

本文素材来源量子位、清华王霞,如有侵权请联系删除

END

本篇文章来源于微信公众号: AIGC开放社区